Az Nvidia kiadta a Groq 3 LPU chipet, amely felgyorsítja az AI‑modellek inferenciáját token szinten.

Az Nvidia felfedi a Vera Rubin új lehetőségeit

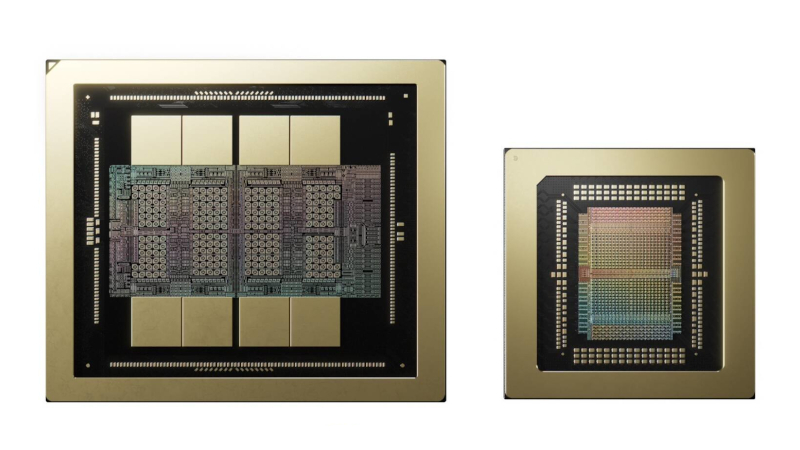

A GTC konferencián ez évben az Nvidia vezérigazgatója, Jensen Huang bejelentette a Vera Rubin platform bővítését. Az új funkciók alapjául a Groq vállalattól vásárolt szellemi tulajdon áll, és a Rubin része lett a *Groq 3 LPU* chip – egy inferencia gyorsító, amely magas sebességgel és alacsony késleltetéssel képes tokeneket kibocsátani.

Mi már elérhető a Vera Rubinben

A platform hat kulcsfontosságú összetevőből áll, amelyeket az Nvidia pontos rendszerekké szervez, majd nagy AI-fábrákra skáláz.

| Összetevő | Leírás |

|---|---|

| GPU Rubin | 288 GB HBM4 videokártya |

| CPU Vera | Központi processzor |

| NVLink 6 | Rendszer belső skálázási rendszer |

| ConnectX‑9 | Intelligens hálózati adapter |

| BlueField‑4 | Adatfeldolgozó processzor |

| Spectrum‑X | Interrendszeri kapcsoló optikai integrációval |

A Groq 3 LPU most új építőelemként került be, amelyet nagy rendszerek telepítésekor használnak.

Miért kiemelkedik a Groq 3 LPU

Az elsődleges különbség a memóriaarchitektúrában rejlik. Míg a legtöbb gyorsító HBM-et használ munkamemóriaként, minden Groq 3 LPU 500 MB SRAM-ot tartalmaz. Összehasonlítás:

| Paraméter | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Kapacitás | 288 GB | 0,5 GB |

| Átviteli sebesség | ~22 TB/s | 150 TB/s |

Az inferencia feladatoknál, ahol a sávszélesség kritikus, az SRAM előnye nyilvánvaló. Ezért az Nvidia beépítette a Groq 3-at a Rubinbe – hogy növelje a token kibocsátásának sebességét.

A Groq 3 LPX rack

A rack 256 darab Groq 3 LPU chipet tartalmaz, amely:

- 128 GB SRAM-t biztosít

- 40 PB/s összesített sávszélességet kínál

- 640 TB/s belső interfész

A hyper‑scalable megoldások vice‑presztíziója, Ian Buck, a rackot Rubin szuperszámítási egységként nevezte el, hangsúlyozva szerepét a modell minden rétegének és tokenjének dekódolási teljesítményének növelésében.

Hatás a multiagent rendszerekre

Buck megjegyezte, hogy a Groq 3 LPX kulcsfontosságú elem lesz a jövő AI-piacában – a multiagent rendszereknél. Amikor az ügynökök közvetlenül cserélik ki az adatokat, nem pedig chat‑botokon keresztül, a válaszidő követelményei változnak: 100 token/s-től 1 500+ token/s-ig és még magasabbra.

Versenytársak és kilátások

A szövegben említett versenytársa a Cerebras, amely a Wafer‑Scale Engine (WSE) -t használ, hatalmas SRAM-mal alacsony késleltetésű inferenciához. Az OpenAI már bevetette a Cerebras-t fejlett modelljeiben a kedvező késleltetés miatt.

Buck azt is hangsúlyozta, hogy a Groq 3 LPU megjelenése csökkentheti a Rubin CPX gyorsító függőségét. Amíg az Nvidia a Groq 3 LPX rack integrációjára koncentrál, mindkét chip célja, hogy erősítse az inferenciát anélkül, hogy nagy GDDR7 memóriára lenne szükség.

Összegzés:

A új Groq 3 LPU chip és LPX rack megerősíti a Vera Rubin-t alacsony késleltetésű inferencia szegmensben, útot nyitva gyorsabb multiagent AI‑rendszerekhez, és versenyezve olyan szereplőkkel, mint a Cerebras.

Asted Cloud

Asted Cloud

Hozzászólások (0)

Oszd meg a véleményed — kérjük, légy udvarias és maradj a témánál.

Jelentkezz be a hozzászóláshoz