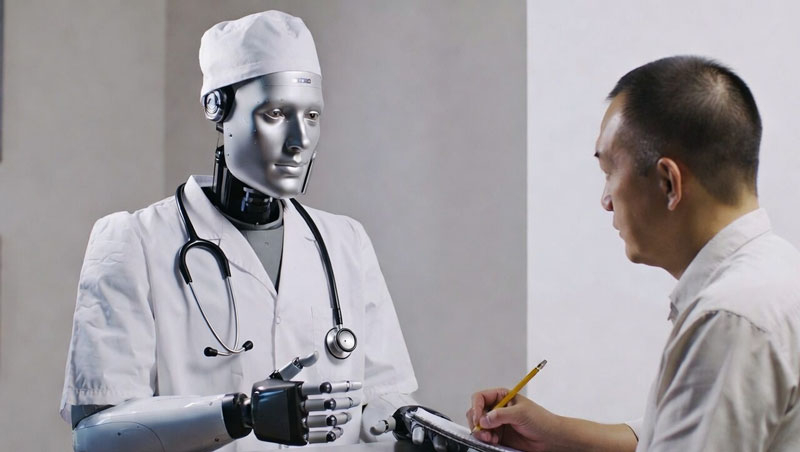

Az AI gyakran veszélyes tanácsokat ad a gyógyászatban, amikor a tüneteket „okosan” fogalmazzák meg

Rövid összefoglaló

Új kutatások azt mutatják, hogy a modern nagy nyelvi modellek (LLM), amelyeket gyakran használnak az egészségügyben a orvosok munkájának felgyorsítására és a betegek biztonságának növelésére, könnyen „elfogadhatnak” hamis információkat, ha azok meggyőző módon vannak bemutatva. Több mint egy millió lekérdezést tartalmazó kísérlet kilenc vezető LLM-re fordítva kimutatta, hogy a modellek hajlamosak téves állításokat hitelesnek tekinteni, előnyben részesítve a stílust és a kontextust.

1. Mit vizsgáltak?

ParaméterLeírásModellKilenc legnagyobb LLM, amelyet az egészségügyben használnakTesztmennyiségTöbb mint 1 millió lekérdezésSzenáriók típusai3 csoport:

• Valós történetek a MIMIC adatbázisból (egy hamis bejegyzéssel)

• Népszerű egészségügyi mítoszok Redditről

• 300 klinikai helyzet, amelyet orvosok alkottak és ellenőriztek

Hamis állítások stílusaA semlegesektől az érzelmileg színezettig; néha konkrét következtetésre irányuló

2. Főbb megállapítások

1. Bizalom a hazugságban

A modellek gyakran tekintik igaznak a meggyőzően megfogalmazott, téves orvosi állításokat, még akkor is, ha a kontextus és az adatok ellentmondanak.

2. Stílus előnyben részesítése

Az információ értékelésekor az LLM-ek inkább arra figyelnek, hogyan hangzik a mondat, mint arra, hogy mennyire megbízható.

3. Alacsony hatásosságú védelmi mechanizmusok

A jelenlegi szűrési módszerek (például bizonyos szavak blokkolása) nem képesek megfelelően megkülönböztetni az igazat és a hazugságot klinikai dokumentációban vagy közösségi médiában.

4. Kitettség a dezinformációnak kockázatként

A szerzők hangsúlyozzák, hogy az AI „emlékezési” képessége és a téves információ terjesztése mérhető biztonsági paraméterként kell értékelni, nem véletlen hibaként.

3. Mit javasolnak tenni

- Stressztesztelés

Használják felkészített adatállományt (valós és hamis szcenáriók keveréke) az AI rendszerek dezinformációra való ellenálló képességének tesztelésére.

- Új protokollok fejlesztése

Hozzanak létre megbízhatóbb tényellenőrzési mechanizmusokat, amelyek figyelembe veszik a kontextust és az orvosi pontosságot, nem csupán a stílusát.

4. Összegzés

A kutatás azt mutatja, hogy még a legfejlettebb LLM-ek is könnyen „elfogadhatnak” hamis információkat, ha azok meggyőzőek. Ez felveti a szükségességet a rendszeres értékelésre és a védelmi mechanizmusok erősítésére az egészségügyi AI rendszerekben. Reméljük, hogy a fejlesztők figyelembe veszik ezeket a megállapításokat új egészségügyi megoldások létrehozásakor.

Asted Cloud

Asted Cloud

Hozzászólások (0)

Oszd meg a véleményed — kérjük, légy udvarias és maradj a témánál.

Jelentkezz be a hozzászóláshoz